Zichicche (n+1): i batteri dormiglioni

Riassunto In questo post si narra di un’altra teoria del Prof. Zichichi priva di alcun fondamento scientifico, apparsa recentemente in prima pagina su un quotidiano nazionale pur essendo stata riciclata...

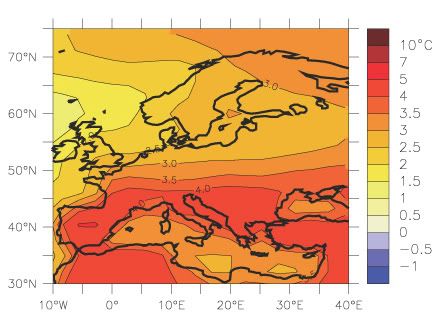

I modelli del clima e la gestione dell’incertezza

Riassunto Si discute in questo post dell’utilità dei modelli di simulazione del clima. Pur con le incertezze che caratterizzano le simulazioni climatiche, alcuni risultati prodotti dai GCM hanno una chiara...

Le variazioni climatiche durante l’ultimo milione di anni: mandanti, killer e alibi (seconda parte)

Nella prima parte di questo post abbiamo individuato i “mandanti” delle variazioni climatiche durante l’ultimo milione di anni (variazioni dei parametri orbitali). Cercheremo ora di analizzare le possibili dinamiche interne...

Le variazioni climatiche durante l’ultimo milione di anni: mandanti, killer e alibi (prima parte)

Il luogo climaticamente più ostile del pianeta è probabilmente l’Antartide Orientale. Qui le temperature medie annuali sono dell’ordine di -55 ºC e le precipitazioni di circa 2-3 cm di acqua...

99 Mesi ?!?

A volte capita di sentire qualcuno che sostiene la necessità di azioni urgenti contro i cambiamenti climatici, usando però argomenti poco fondati. È il caso del Principe Carlo d’Inghilterra, che nella...