Sintesi: l’analisi a scala globale dei dati relativi al bimestre dicembre ’08-gennaio ’09 appena trascorso mostra che tale periodo non può essere considerato eccezionale non solo dal punto di vista climatico (in quanto una singola stagione non dice nulla sul clima), ma neppure da quello meteorologico, in quanto le anomalie termiche e pluviometriche riscontrate hanno riguardato soltanto una piccola porzione del territorio nazionale (peraltro compatibili con quelle verificatesi negli anni precedenti) mentre a livello globale l’anomalia termica e’ addirittura stata positiva.

a

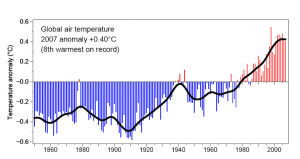

Fa freddo. È questo il commento un po’ generale che imperversa ormai dall’inizio di dicembre. Ma non vorrei qui ripetere per l’ennesima volta quale sia la differenza tra tempo meteorologico e clima (concetto già ribadito più volte nei post precedenti), quanto piuttosto insistere sul fatto che occorre sempre analizzare i dati nella loro globalità, non in singole stazioni. Infatti, se anche l’inverno 2008-09 avesse fatto registrare in qualche stazione italiana, o anche, al limite, in tutta Italia, i valori minimi di temperatura delle serie storiche (cosa che, come vedremo, non è vera), non si potrebbe comunque parlare di cambiamento del clima, ma solo di un evento o di una serie di eventi, al limite insoliti; inoltre, analizzando la situazione globale, si scoprirebbe che questo evento probabilmente è bilanciato da una altrettanto significativa anomalia calda in altre zone del mondo.

Il mio obbiettivo è quindi quello di rispondere alla domanda: “quest’anno è stato freddo o no?” facendo chiarezza ed esaminando i dati disponibili.

Non essendo ancora terminato l’inverno (che meteorologicamente finisce a fine febbraio), possiamo commentare i primi due mesi dell’inverno meteorologico 2008-2009 usando le mappe meteorologiche che ho creato utilizzando i dati messi a disposizione dalla NOAA (National Oceanic and Atmospheric Administration) su questo sito. È un giochino interessante e chiunque può divertirsi facendosi la propria climatologia: si possono visualizzare una ventina di variabili sulla porzione del globo terrestre che più interessa, alla risoluzione spaziale di 2.5 gradi in longitudine e latitudine (cioè circa 125 Km alle nostre latitudini, non sufficiente per i dettagli locali ma sufficiente per gli andamenti generali), e si può calcolare l’anomalia della grandezza considerata, cioè la differenza fra il valore registrato in un certo periodo e il valore medio su un periodo di riferimento. NOAA ha scelto come periodo di riferimento il 1968-1996, che è un po’ diverso dal trentennio abitualmente scelto come riferimento 1961-90 (volendo, con un po’ di tempo in più si può scegliere il periodo che si vuole) ma le differenze non sono poi così significative. Ho quindi creato i grafici delle anomalie di temperatura e precipitazione relative agli ultimi due mesi di dicembre 2008 e gennaio 2009 confrontandoli con le medie.

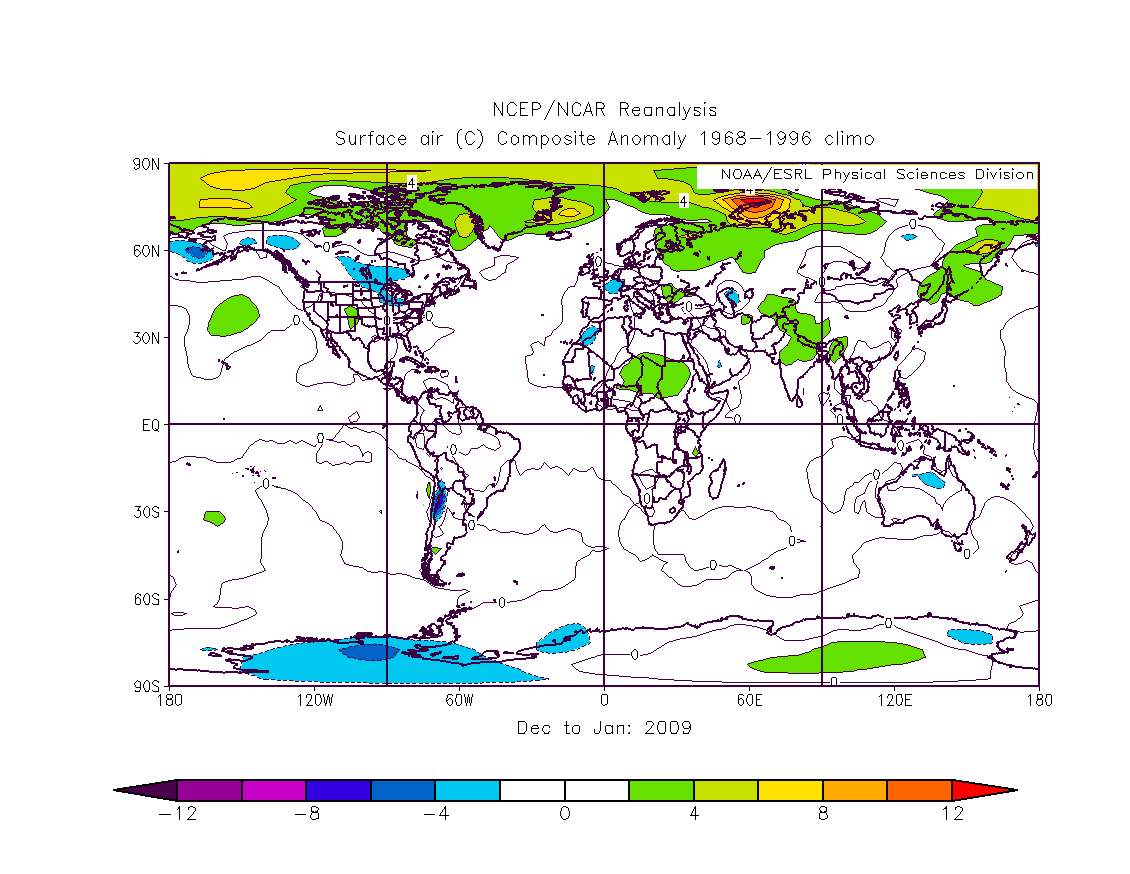

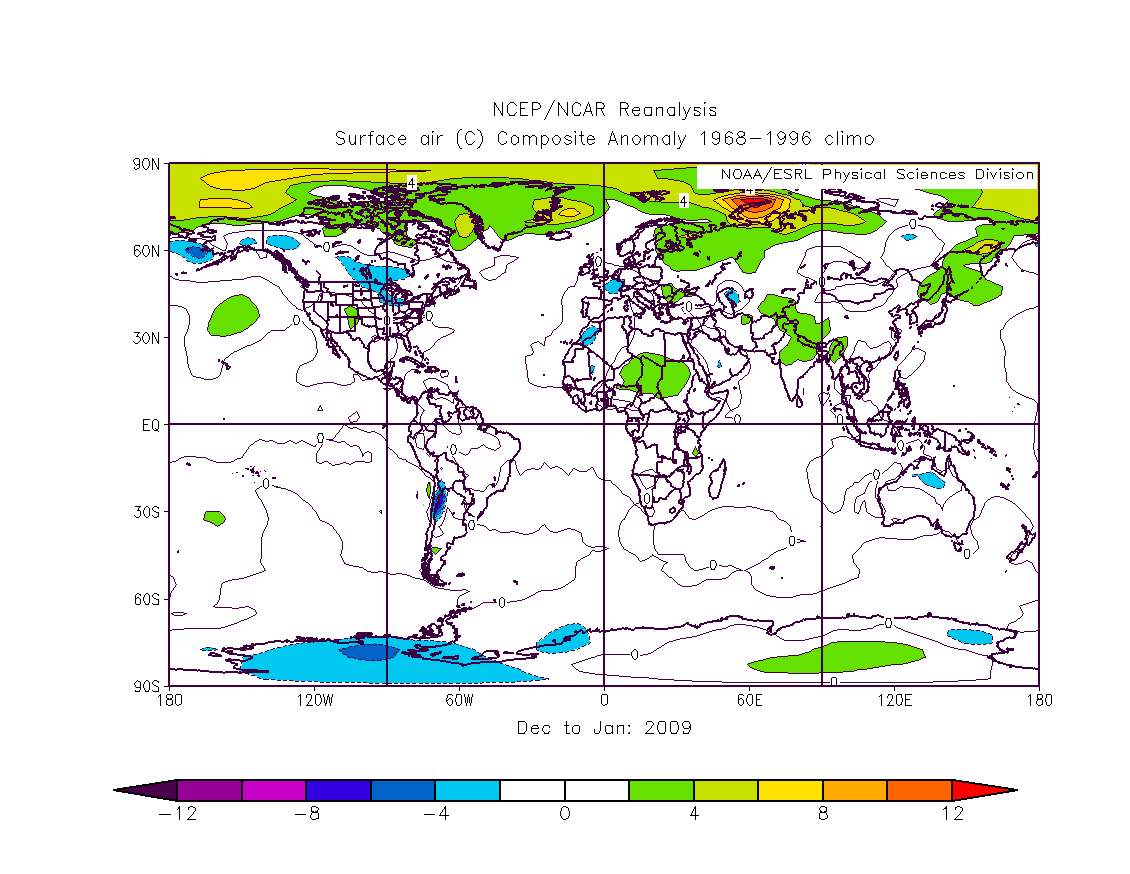

Cominciamo a vedere la mappa che riporta le anomalie a scala globale (Fig. 1 – i colori blu e rosso scuro evidenziano, come nei rubinetti, le zone rispettivamente con anomalia negativa e positiva).

Figura 1 – Anomalia di temperatura superficiale sul globo terrestre 1 Dicembre 2008 – 30 Gennaio 2009 rispetto al periodo di riferimento 1968-1996. Grafico generato dalle informazioni NOAA.

Beh, sicuramente non si può dire che, a scala globale, sia stato un bimestre freddo. Ci sono, è vero, dei minimi (Antartide, Stati Uniti, Cile), ma anche dei massimi, in particolare sulle regioni del Polo Nord, nei pressi delle isole Svalbard (fino a 12 °C!). Facendo uno zoom sull’emisfero Nord (Fig. 2), si notano delle ampie zone con anomalie positive sull’Africa, sulle zone polari, sul Pacifico, e due piccole aree al centro degli Stati Uniti e sull’Ungheria, mentre sono presenti alcune zone di anomalia negativa sul Canada e sugli Stati Uniti orientali, nei pressi dell’Alaska, e in altre quattro piccole zone distribuite tra Europa, Africa settentrionale e Asia. Come chiunque può vedere, l’estensione delle aree con anomalia positiva è nettamente maggiore di quelle con anomalia negativa, per cui si può dire che, per quanto riguarda l’emisfero nord, il bimestre considerato è stato più caldo della norma.

Figura 2 – Anomalia di temperatura superficiale sull’emisfero Nord nel periodo 1 Dicembre 2008 – 30 Gennaio 2009 rispetto al periodo di riferimento 1968-1996. Grafico generato dalle informazioni NOAA.

I dettagli sulla zona europea (Fig. 3) e sull’Italia (Fig. 4) riportano un numero maggiore di isolinee e mostrano una zona con anomalie negative di temperatura con i minimi sulla Francia centrale e sul Marocco estesa dalla Germania meridionale fino all’Africa nord-occidentale, e che lambisce anche l’Italia nordoccidentale. Il resto dell’Italia si trova in una zona intermedia che confina con un’area molto ampia di anomalie termiche positive che si estende dal Mediterraneo orientale verso nord.

Figura 3 – Anomalia di temperatura superficiale sull’Europa nel periodo 1 Dicembre 2008 – 30 Gennaio 2009 rispetto al periodo di riferimento 1968-1996. Grafico generato dalle informazioni NOAA.

Figura 4 – Anomalia di temperatura superficiale sull’Italia nel periodo 1 Dicembre 2008 – 30 Gennaio 2009 rispetto al periodo di riferimento 1968-1996. Grafico generato dalle informazioni NOAA.

Dunque, si è effettivamente registrata un’anomalia di temperatura lievemente negativa su una parte del territorio nazionale, del resto confermata anche dall’analisi condotta dal Centro Nazionale di Meteorologia e Climatologia Aeronautica sul Bollettino Climatico di Gennaio 2009. Quanto è significativo questo dato? Per rispondere a questa domanda, ho generato le mappe relative alle anomalie di temperatura sul territorio nazionale e sulle aree limitrofe relative agli ultimi 12 periodi invernali dicembre-gennaio (reperibili su questo sito). La loro analisi mostra chiaramente che questo bimestre non è stato né l’unico né il più freddo nel periodo considerato. Se è vero, infatti, che ci sono stati dei bimestri nettamente più caldi (1997-98, 2000-01, e il famigerato 2006-07), è anche vero che non mancano gli anni con anomalie negative (1998-99 solo sul sud Italia, 1999-2000, 2001-2, 2003-4, 2004-5 solo sul nord Italia, e poi il bimestre 2005-6, molto più freddo su tutto il territorio nazionale rispetto a quello attuale).

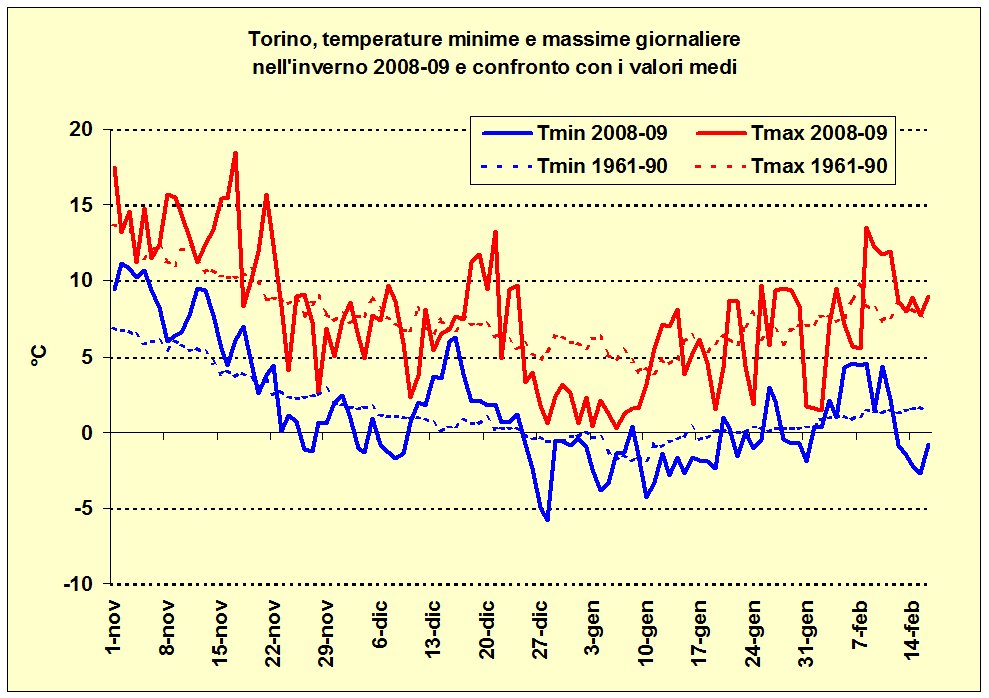

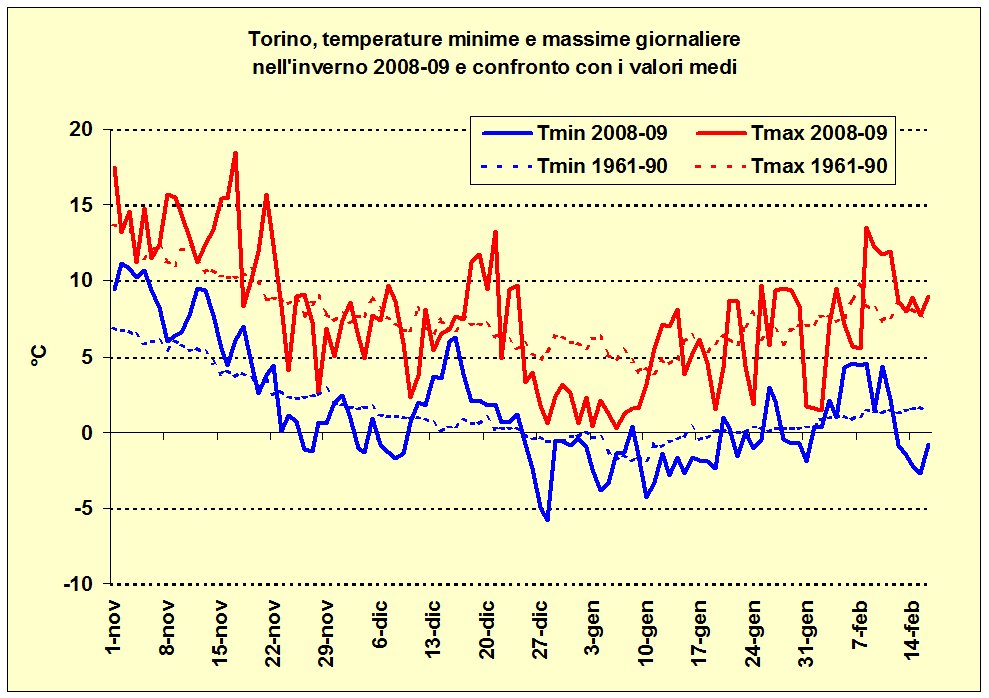

Per un maggiore dettaglio su una singola località, tra tutte le possibili scegliamo Torino, un po’ perché ci abito, ma soprattutto perché, grazie all’encomiabile meticolosità ventennale di Luca Mercalli e Gennaro Di Napoli, culminato nel libro “Il clima di Torino” (un’enciclopedia di oltre 900 pagine, disponibile su questo sito della Società Meteorologica Italiana) appena pubblicato, sono disponibili i dati di temperatura dal 1753, di pioggia giornaliera dal 1802 e di neve cumulata giornaliera dal 1787 (quest’ultima è la serie più lunga al mondo), tutte omogeneizzate, e le analisi su tali dati. Paragonando la temperatura invernale a Torino con la media relativa al periodo 1961-90 (Fig. 5), si osserva come sostanzialmente si sia verificata una leggera anomalia negativa, pari rispettivamente a –0.4°C per le minime ed a –0.7°C per le massime, dovuta principalmente alle irruzioni fredde dei primi 12 giorni di dicembre e da Natale all’11 gennaio.

Figura 5 – Andamento delle temperature minime e massime giornaliere rilevate a Torino nel periodo 1 novembre 2008 – 16 febbraio 2009 paragonate con i valori medi relativi al trentennio 1961-1990. Dati forniti dalla Società Meteorologica Italiana, elaborazioni a cura di Daniele Cat Berro e Luca Mercalli.

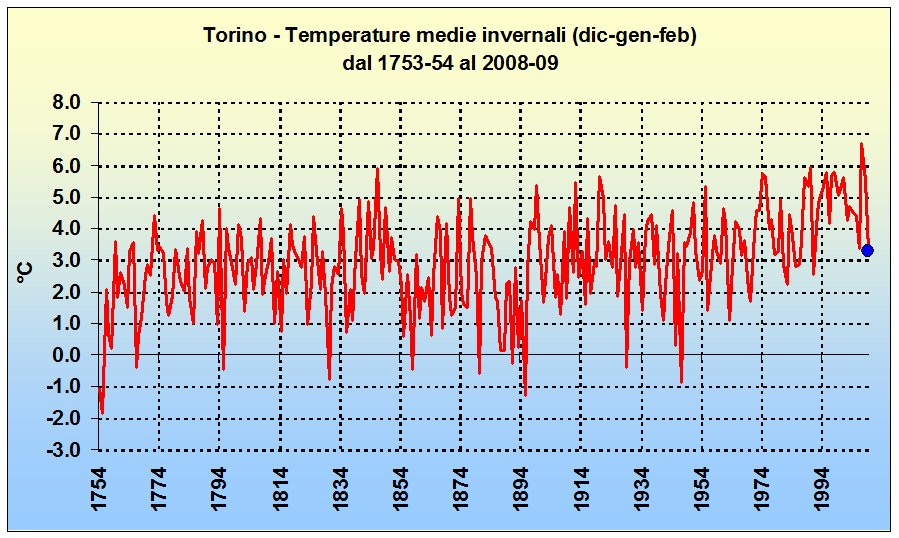

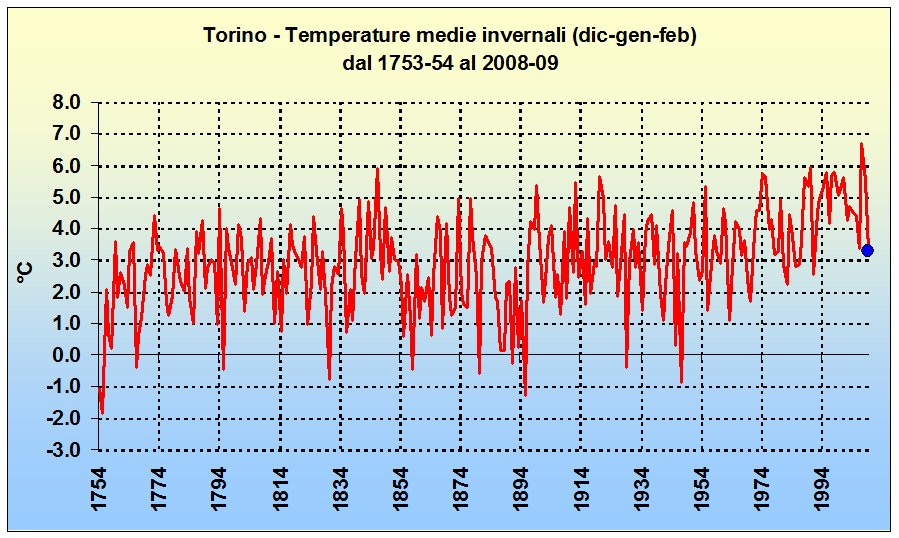

La stima provvisoria della temperatura media a Torino relativa al trimestre invernale (dicembre-febbraio) è di 3.3°C (manca però metà febbraio), simile all’inverno 2005-06 (3.4 °C) ed inferiore alla media 1961-90 (3.8 °C), come si può vedere nella Fig. 6.

Figura 6 – Andamento delle temperature medie del trimestre invernale dicembre-febbraio durante l’intero arco delle misure relative alla serie storica di Torino. Dati forniti dalla Società Meteorologica Italiana, elaborazioni a cura di Daniele Cat Berro e Luca Mercalli.

E per quanto riguarda le precipitazioni, che cosa si può dire? Analizzando i grafici delle anomalie del rateo di precipitazione (in mm/giorno) sull’Italia (Fig. 7), si nota l’evidente area di anomalia positiva (colore blu) che coinvolge l’intero territorio nazionale nell’ultimo bimestre, con un picco evidente sulle regioni meridionali italiane: il 2008-09 è stato effettivamente un bimestre abbastanza piovoso (o nevoso, in certe zone).

Figura 7 – Anomalia di rateo di precipitazione (mm/giorno) sull’Italia nel periodo 1 Dicembre 2008 – 30 Gennaio 2009 rispetto al periodo di riferimento 1968-1996. Grafico generato dalle informazioni NOAA.

Ma il confronto con gli altri 12 bimestri invernali riportati su questo sito per gli ultimi 12 bimestri invernali dicembre-gennaio mostra che, sulle regioni meridionali italiane, anomalie simili si sono verificate anche in altri anni (in particolare nei quattro inverni consecutivi dal 2002-3 al 2005-6, e nel 2007-8), mentre per quanto riguarda il nord Italia le anomalie positive sono state effettivamente molto più rare.

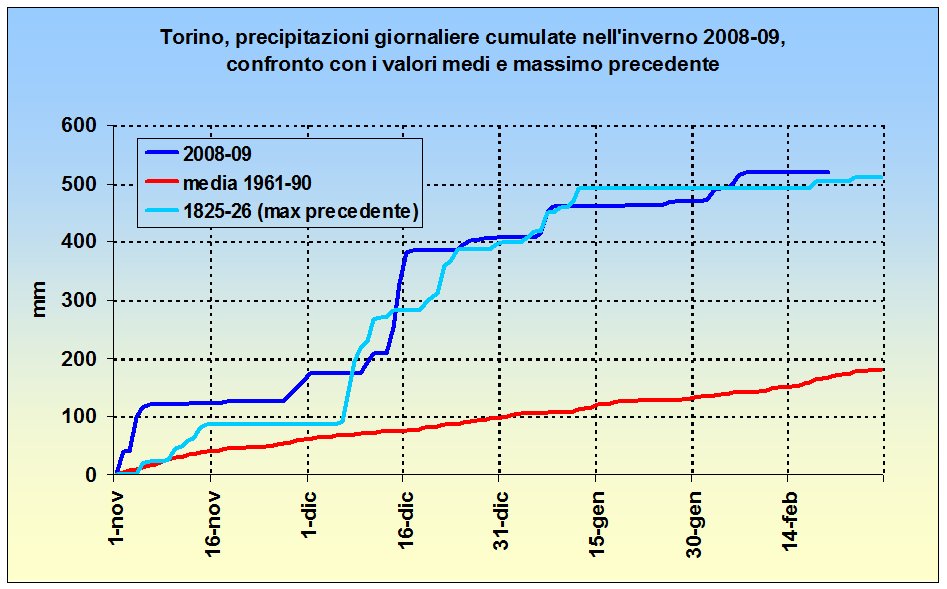

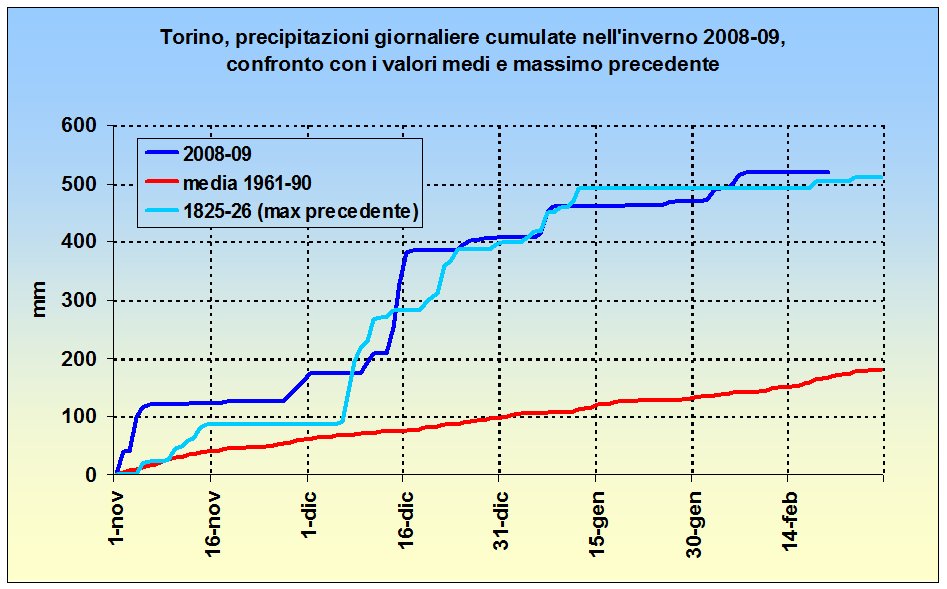

A Torino, in particolare (Fig. 8), dal 1° novembre al 20 febbraio, si sono accumulati ben 518.7 mm, dovuti principalmente ai due eventi di inizio novembre (120 mm) e metà dicembre (211 mm), e tale quantitativo rappresenta il record di tutta la serie per quanto riguarda il periodo novembre-febbraio (il record precedente fu registrato nel lontano 1825-26, con 509.4 mm).

Figura 8 – Precipitazioni (pioggia e neve fusa) giornaliere accumulate nel periodo novembre 2008 – febbraio 2009 registrate a Torino: confronto con la media del trentennio 1961-90 e con il massimo quadrimestrale precedente. Dati forniti dalla Società Meteorologica Italiana, elaborazioni a cura di Daniele Cat Berro e Luca Mercalli.

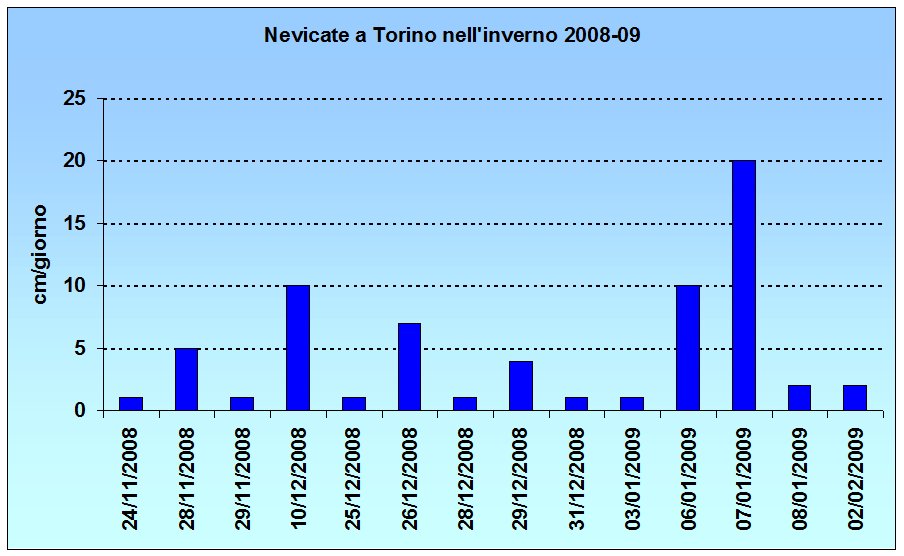

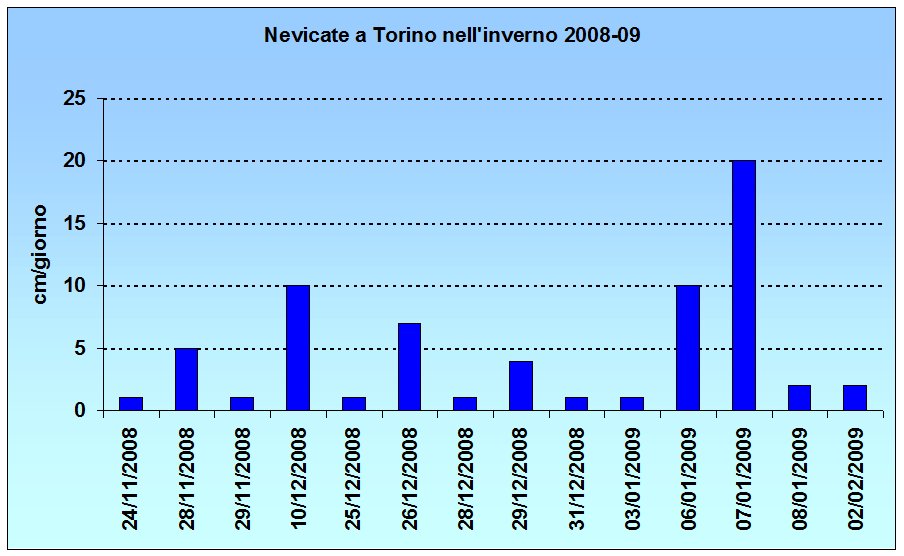

Le temperature più rigide e le precipitazioni più abbondanti a Torino hanno avuto come conseguenza un incremento notevole del numero e dell’intensità delle nevicate: a fronte di una media di 7.2 giorni con nevicate nel periodo 1961-90, nel 2008-09 si è visto nevicare in 14 giornate (Fig. 9), valore nettamente inferiore al massimo storico di 30 episodi del 1837 (ma in tale epoca si stava uscendo dalla Piccola Età Glaciale), ma nettamente superiore a quelli degli ultimi anni (era dal 1986 che non nevicava così frequentemente: 16 giorni).

Figura 9 – Giorni con nevicate nel periodo novembre 2008 – febbraio 2009 a Torino e quantitativo di neve accumulata giornaliera. Dati forniti dalla Società Meteorologica Italiana, elaborazioni a cura di Daniele Cat Berro e Luca Mercalli.

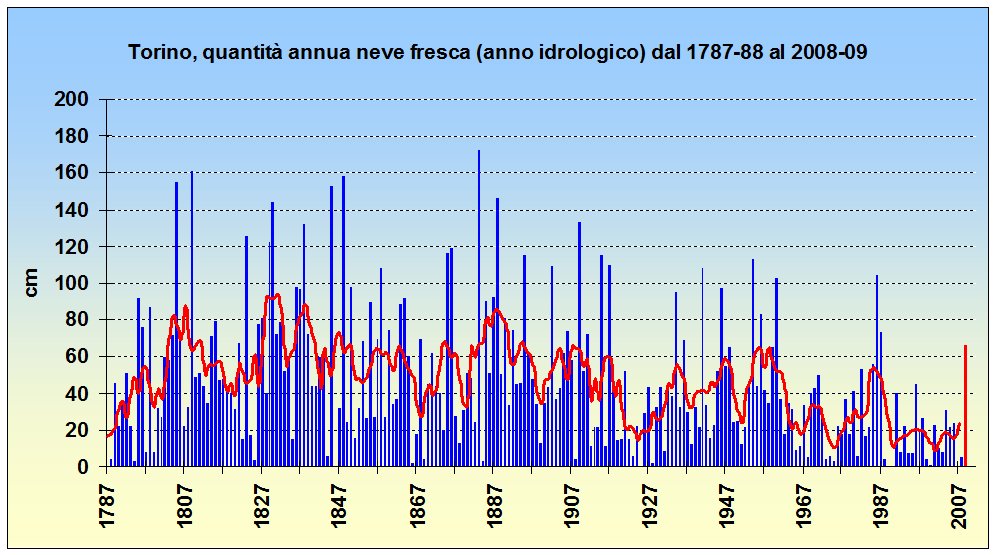

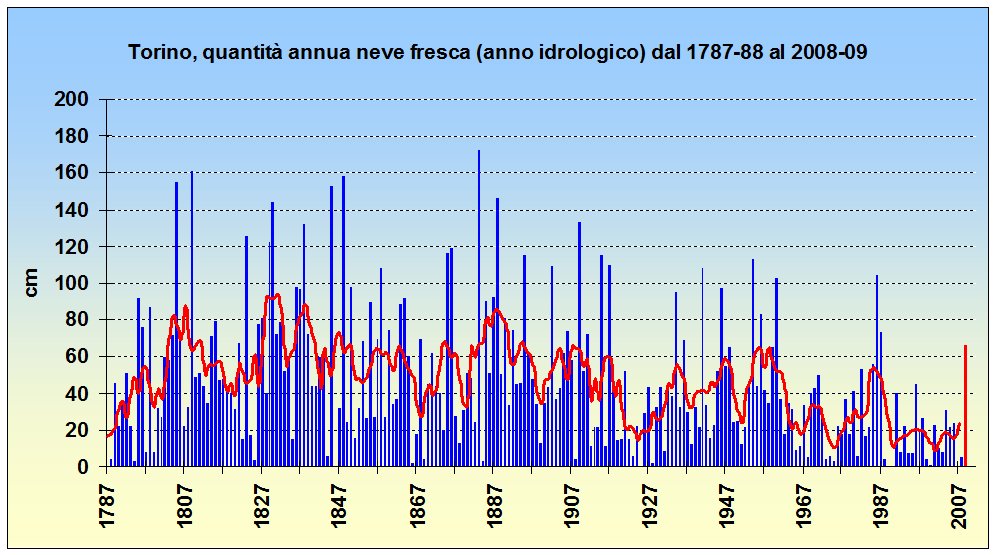

Il manto totale depositatosi in città nel trimestre dicembre-febbraio è stato di 66 cm (di cui 32 cm tra il 6 e l’8 gennaio), valore nettamente superiore alla media 1961-90 (28 cm) ed ai valori tipici degli ultimi anni (quando in ben tre casi – nel 1988-89, 1989-90 e 2006-07 – non nevicò affatto in città: si veda la Fig. 10).

Figura 10 – Neve fresca accumulata nell’anno idrologico registrata presso gli osservatori della serie storica di Torino dal 1787 a oggi. Dati forniti dalla Società Meteorologica Italiana, elaborazioni a cura di Daniele Cat Berro e Luca Mercalli.

L’analisi appena condotta, sia pure parziale poiché la stagione non è ancora terminata, mostra comunque che il bimestre appena trascorso non può essere considerato eccezionale non solo dal punto di vista climatico (in quanto una singola stagione non dice nulla sul clima), ma neppure da quello meteorologico, in quanto le anomalie riscontrate sono compatibili con quelle verificatesi negli anni precedenti.

L’Italia settentrionale, ed in particolare quella nordoccidentale, ha registrato temperature leggermente inferiori alla norma e precipitazioni superiori alla norma, almeno per quanto riguarda gli ultimi 12 bimestri invernali, fatto che ha comportato un incremento nel numero delle nevicate anche a quote di pianura. I valori termici registrati in Italia nordoccidentale nello scorso inverno si sono avvicinati alle medie relative al periodo di riferimento 1961-90 e, forse proprio per questo motivo, sono state percepite come insolitamente fredde se paragonate con quelle registrate negli ultimi inverni. L’Italia meridionale ha invece registrato sia temperature sia, soprattutto, precipitazioni superiori alla norma, cosa peraltro già verificatasi frequentemente negli ultimi 12 anni.

Testo di: Claudio Cassardo

I numeri appena citati non annunciano catastrofi, non ci parlano di danni enormemente ingenti che il sistema economico italiano potrebbe trovarsi ad affrontare; il libro mette l’accento sull’esigenza di intraprendere politiche che richiedono strategie di lungo periodo. E lo fa a partire dalla metodologia utilizzata. La ricerca prende in considerazione i danni attesi dai cambiamenti climatici dopo che l’intero sistema economico avrà compiuto un adattamento autonomo, avrà cioè reagito agli effetti negativi dando luogo a un nuovo equilibrio. È a questo punto, che la ricerca calcola il danno atteso dai cambiamenti climatici.

I numeri appena citati non annunciano catastrofi, non ci parlano di danni enormemente ingenti che il sistema economico italiano potrebbe trovarsi ad affrontare; il libro mette l’accento sull’esigenza di intraprendere politiche che richiedono strategie di lungo periodo. E lo fa a partire dalla metodologia utilizzata. La ricerca prende in considerazione i danni attesi dai cambiamenti climatici dopo che l’intero sistema economico avrà compiuto un adattamento autonomo, avrà cioè reagito agli effetti negativi dando luogo a un nuovo equilibrio. È a questo punto, che la ricerca calcola il danno atteso dai cambiamenti climatici.

di “Perimenontas tous barbarous” (Aspettando i barbari):

di “Perimenontas tous barbarous” (Aspettando i barbari): milione di chilometri quadrati in piú rispetto al 2007”. È una frase che non ha molto senso perchè non è possibile confrontare l’estensione dei ghiacci della “primavera” del 2008 con quella del 2007.

milione di chilometri quadrati in piú rispetto al 2007”. È una frase che non ha molto senso perchè non è possibile confrontare l’estensione dei ghiacci della “primavera” del 2008 con quella del 2007.