La scienza del clima vintage – e sbagliata – di Franco Prodi

Fra chi nega in modo ostinato la responsabilità delle attività umane sulle variazioni climatiche e i pericoli legati alle variazioni future, il prof. Franco Prodi è quello considerato più autorevole...

Un’irresponsabile e ostinata ciclomania

Sembrerà incredibile, ma proprio nelle settimane in cui l’Italia e l’Europa sono state colpite da lunghe e pesanti ondate di calore, che per l’ennesima volta hanno frantumato record storici e...

Le previsioni “possibili” nel federalismo del meteo – seconda parte

Pubblichiamo la seconda parte del post in cui sono spiegati gli errori e le tesi infondate proposte dal prof. Franco Prodi, nell’articolo-intervista apparso sul Corriere della Sera del 2 marzo...

Assegnato il premio “A qualcuno piace caldo” 2011

In seguito alla votazione effettuata dai membri del Comitato Scientifico di Climalteranti.it, i vincitori del premio “A qualcuno piace caldo” per l’anno 2011 sono risultati essere Luigi Vigliotti e la...

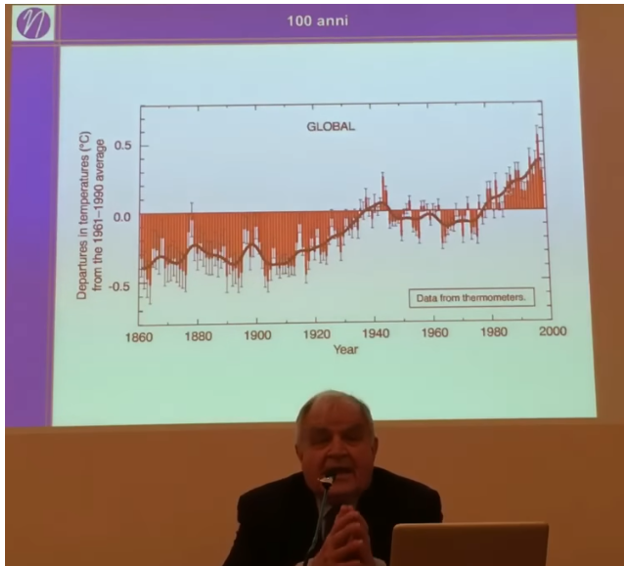

Ancora errori da Franco Prodi sul clima

In un’intervista pubblicata da Repubblica del 20 maggio, il Prof. Franco Prodi ha affermato che “in questi 50 anni il clima in Italia è cambiato davvero poco”, che il riscaldamento...

COP15: luci, ombre …e bufale

L’accordo di Copenhagen del 18 dicembre 2009 rappresenta sicuramente una delusione per quanti avevano posto grandi aspettative nella COP15, la quindicesima sessione della Conferenza delle Parti sui cambiamenti climatici. I...

Il 1912.. praticamente ieri

Le argomentazioni negazioniste sul clima sono a volte complesse e richiedono spiegazioni interessanti ma un po’ impegnative (un esempio in questa traduzione di Realclimate). Altre volte sono semplici e già...

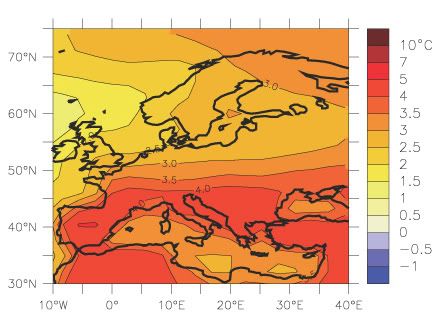

I modelli del clima e la gestione dell’incertezza

Riassunto Si discute in questo post dell’utilità dei modelli di simulazione del clima. Pur con le incertezze che caratterizzano le simulazioni climatiche, alcuni risultati prodotti dai GCM hanno una chiara...

Un bel libro con una Prefazione poco aggiornata

Fra i libri più belli pubblicati negli ultimi anni sui cambiamenti climatici va senza dubbio citato “Piccola lezione sul clima” di Kerry Emanuel, professore di Scienze dell’Atmosfera al MIT di...